Com a popularização de ferramentas como o ChatGPT, muitas pessoas estão descobrindo as vantagens de usar inteligência artificial no seu dia a dia. De respostas rápidas a soluções criativas, a IA pode ser uma grande aliada. Mas, como qualquer tecnologia que lida com dados, existem riscos envolvidos no uso dessa ferramenta, principalmente em relação à privacidade. Se você está começando a usar o ChatGPT, é importante saber o que NÃO dizer a ele para evitar problemas. Afinal, nem toda informação deve ser compartilhada com um chatbot, mesmo que seja bem-intencionado.

1. Pedidos Ilegais ou Antiéticos: Evite Consequências Legais

Embora o ChatGPT tenha proteções integradas para evitar o uso em atividades ilegais, isso não significa que você esteja livre de possíveis consequências legais. Pedir informações sobre como cometer crimes, fraudar documentos ou manipular pessoas são ações que podem não apenas violar os termos de uso da plataforma, mas também envolver questões legais sérias. Vale lembrar que, dependendo do país, os chatbots podem ser obrigados a reportar atividades suspeitas para as autoridades. Então, sempre lembre-se: respeitar as leis e agir eticamente é fundamental, seja no mundo físico ou digital.

MEI 360: O sistema do Jornal Contábil é ideal para revolucionar a gestão do seu negócio! Conheça Agora

2. Nunca Compartilhe Suas Senhas e Logins

Com a crescente integração de sistemas, é possível que, ao usar ferramentas como o ChatGPT, você seja solicitado a inserir dados pessoais como senhas ou logins. Mas, acredite, isso é um erro! Informações como senhas bancárias ou de redes sociais não devem ser compartilhadas com ferramentas de IA. O risco de vazamento de dados é grande, já que, em algumas ocasiões, dados pessoais inseridos por um usuário acabaram sendo expostos em conversas com outros usuários. Proteja suas informações e sempre use plataformas seguras e criptografadas para armazenar suas credenciais.

3. Informações Financeiras: Nunca Insira Dados Sensíveis

Embora o ChatGPT seja uma excelente ferramenta para resolver dúvidas gerais, ele não deve ser usado para questões financeiras. Não insira dados como números de contas bancárias, cartões de crédito ou transações financeiras. Isso pode resultar em vazamentos de informações confidenciais, com sérios riscos para sua segurança financeira. Em vez disso, sempre utilize plataformas específicas e seguras, como bancos e sistemas financeiros online que ofereçam criptografia e exclusão automática de dados após o uso.

Veja mais:

- Atualizado! As 5 coisas que nãos e deve dizer ao ChatGPT em 2025

- Quem tem não conta! WhatsApp lança nova ferramenta apenas para alguns

- 9 mulheres brasileiras têm fortuna maior que R$ 5 bilhões

- Antes de receber seus dividendos saiba quais as “armadilhas” do investimento

- Aluguel sobe, mas atinge recorde nessas 10 cidades brasileiras

4. Evite Compartilhar Informações Confidenciais e Corporativas no ChatGPT

Você pode achar tentador compartilhar documentos ou informações sensíveis com o ChatGPT, mas isso pode ser uma violação de confidencialidade, especialmente para profissionais de áreas como medicina, direito e contabilidade. Caso você trabalhe com dados de clientes, como registros médicos, informações empresariais ou segredos comerciais, é importante não inserir esse tipo de dado em plataformas não seguras. Isso pode resultar em prejuízos para sua carreira e até mesmo problemas legais, como ocorreu com funcionários de empresas como a Samsung, que foram punidos por vazamento de dados.

5. Não Use o ChatGPT para Diagnósticos Médicos ou Consultas de Saúde

Embora o ChatGPT seja altamente capaz de fornecer informações sobre diversos assuntos, ele não substitui a consulta com um profissional qualificado. Usar a ferramenta para tentar diagnosticar problemas de saúde, especialmente se você fornecer informações pessoais ou sintomas específicos, pode ser arriscado. Além de questões de privacidade, a IA não possui a expertise necessária para fazer diagnósticos médicos precisos. Se você precisar de orientação médica, o melhor a fazer é procurar um médico especializado, que possa avaliar sua condição com a atenção que ela merece.

Proteja sua Privacidade ao Usar o ChatGPT

O ChatGPT é, sem dúvida, uma das ferramentas mais inovadoras da atualidade, mas, como qualquer tecnologia, requer cuidado no uso. Sempre que estiver interagindo com o bot, lembre-se de que qualquer informação compartilhada pode estar sujeita a vazamentos. Então, antes de inserir qualquer dado pessoal ou confidencial, pergunte-se: “Eu me sentiria confortável com isso sendo público?”. Se a resposta for não, é melhor não compartilhar.

Além disso, sempre que possível, consulte canais oficiais e seguros para lidar com questões mais sensíveis, como saúde, finanças e informações confidenciais. Com a devida cautela, você poderá aproveitar todos os benefícios da IA sem colocar sua segurança e privacidade em risco.

Por fim, não se esqueça de estar sempre atento às atualizações de privacidade e segurança das plataformas que você usa. A tecnologia é uma aliada poderosa, mas a proteção de seus dados pessoais é uma responsabilidade que não deve ser negligenciada.

O post Atualizado! As 5 coisas que nãos e deve dizer ao ChatGPT em 2025 apareceu primeiro em Jornal Contábil – Independência e compromisso.

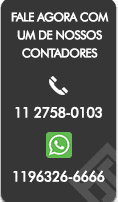

Contabilidade em SBC é com a Dinelly. Fonte da matéria: Jornal Contábil